Datos Técnicos Históricos

- Fundación Oficial: 1956 (Dartmouth)

- Primer Programa: Logic Theorist (1955)

- Primer Lenguaje: LISP (1958)

- Creador del Término: John McCarthy

- Paradigma Actual: Deep Learning / Transformers

Génesis: Los Pioneros y el Nacimiento de una Idea

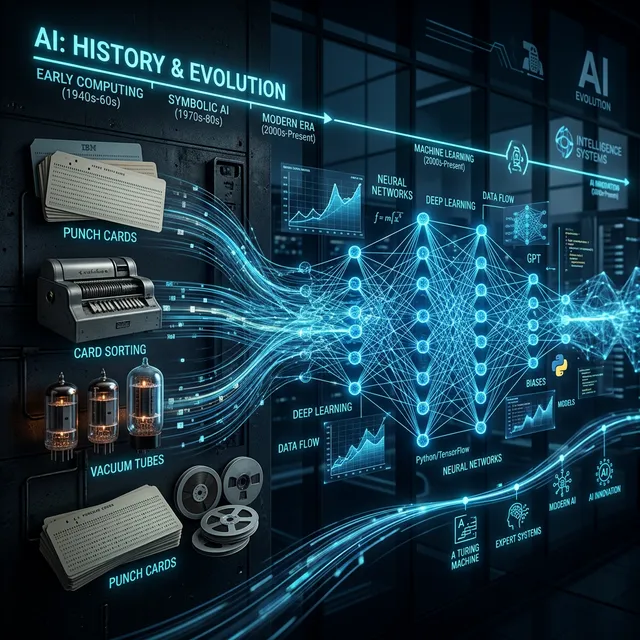

Contrario a la creencia popular dominada por los medios del siglo XXI, la noción de dotar a una entidad artificial de intelecto se remonta formalmente a mediados del siglo XX. El matemático brillante británico Alan Turing sembró el terreno especulativo en 1950 al publicar su ensayo monumental "Computing Machinery and Intelligence", donde formuló la famosa pregunta: "¿Pueden pensar las máquinas?", presentando el "Test de Turing" como medidor de inteligencia.

Sin embargo, la cuna biológica de la IA como campo científico formal ocurrió en Estados Unidos. Fue el verano de 1956, en la Universidad de Dartmouth (Nuevo Hampshire). Un joven investigador de matemáticas de apenas 28 años llamado John McCarthy (nacido en Boston) redactó una propuesta para reunir a un conjunto selecto de mentes brillantes, acuñando por primera vez en toda la historia de la humanidad el término "Inteligencia Artificial".

El Primer Programa Real: El "Logic Theorist"

Previo al evento de Dartmouth, entre 1955 y 1956, Allen Newell, Herbert A. Simon y el programador Cliff Shaw lograron una hazaña informática insólita: crearon un software bautizado como Logic Theorist. Su objetivo no era calcular simples pólizas numéricas, sino razonar de forma simbólica. El programa logró deducir de forma autónoma 38 de los primeros 52 teoremas del libro Principia Mathematica (de Russell y Whitehead), un logro estelar que asombró a la comunidad científica internacional, ya que ejecutaba la inferencia lógica que antes se consideraba de orden exclusivamente biológico. Para programar los primeros softwares, John McCarthy diseñó en 1958 el lenguaje de programación LISP (LISt Processing), que rigió la industria de la IA por más de cincuenta años.

La Evolución: De los "Inviernos" al Boom del Deep Learning

Las décadas posteriores a 1960 desataron altísimas expectativas. Organismos militares como DARPA invirtieron fortunas en el desarrollo de lenguajes de traducción y redes expertas. Sin embargo, los investigadores pronto descubrieron el inmenso reto de replicar el sentido común humano (la complejidad computacional ahogaba a los limitados procesadores de la época).

Esto originó los temidos "Inviernos de la IA" (1974-1980 y 1987-1993), periodos lúgubres de estancamiento donde la financiación estatal y corporativa desapareció tras sucesivas decepciones técnicas.

El paradigma cambió rotundamente entrado el siglo XXI gracias a dos catalizadores exógenos: el abaratamiento masivo de los microprocesadores gráficos (GPUs de NVIDIA) y la creación masiva del Internet que produjo terabytes de datos de entrenamiento invaluables. El hito global ocurrió en 2012, cuando la red neuronal convolucional AlexNet demostró el poder de un sistema profundo (Deep Learning). Posteriormente, en 2017, ingenieros de Google publicaron un artículo que cambió la historia llamado "Attention Is All You Need", creando la revolucionaria arquitectura del algoritmo Transformer, la mismísima tecnología fundacional que le da la letra "T" a ChatGPT de OpenAI.

El Impacto Definitivo en la Humanidad

Analizamos quirúrgicamente los contrastes que este avance tecnológico ha desatado a nivel social, médico y laboral en la estructura de nuestra civilización.

Beneficios y Oportunidades

- 1. Cura de Patologías e I+D Médica Acelerada: Históricamente, el entendimiento del genoma y las proteínas humanas tomaba décadas. Con algoritmos como AlphaFold de DeepMind, la IA ha decodificado predicciones 3D de 200 millones de proteínas con exactitud quirúrgica, abaratando el tiempo de desarrollo de medicamentos oncológicos e inmunoterapias de años a meros meses.

- 2. Estabilización de Escalas de Producción (Abaratamiento global): Las cadenas logísticas gestionadas por Machine learning han extirpado cuellos de botella y pérdidas energéticas, derivando en caídas significativas de los precios reales en comodities y una eficiencia agraria/tecnológica mundial que alimenta a masas de forma barata.

- 3. Liberación Cognitiva y Reducción de Riesgos: Tareas mineras extremadamente mortales, exploración espacial o manipulación de agentes patógenos son ahora ejecutadas por robótica inteligente. Además, la liberación del humano de labores tediosas y burocráticas le permitirá dedicarse plenamente a sectores creativos o críticos.

Afectaciones y Peligros Actuales

- 1. El Estallido Laboral Estructural: La automatización ya no reemplaza solo músculos. Hoy los Modelos de Lenguaje están sustituyendo abogados junior, redactores masivos, programadores y asistentes contables. Esto amenaza con originar un fuerte desplazamiento laboral que requiere reformas sociopolíticas urgentes en el tejido fiscal (como renta básica universal).

- 2. Muerte de la Autoridad Documental (Deep Fakes y Fake News): Las inteligencias generativas vocales y visuales están aniquilando el paradigma visual de la evidencia irrefutable. Ya no se puede probar legalmente que un video es veraz al 100%, facilitando mecanismos masivos para desestabilizar elecciones democráticas a escala global.

- 3. Amplificación de Sesgos (Discrimnación Algorítmica): Los modelos neurales reflejan los historiales con los que han sido entrenados. Cuando entrenamos inteligencias financieras con datos en los cuales minorías no recibían crédito históricamente, el modelo automatiza el racismo a la luz del preámbulo empresarial de "decisión neutral matemática".

El Futuro Inmanente: AGI y ASI

La tecnología que experimentamos actualmente (las redes recurrentes y transformadores de OpenAI, Meta o Google) clasifica rigurosamente como Inteligencia Artificial Estrecha (ANI - Artificial Narrow Intelligence). Si bien son asombrosamente avanzadas, operan únicamente en su trinchera de entrenamiento y carecen enteramente de flexibilidad cognitiva transversal.

La revolución final a mediano plazo (que analistas fechan en el margen del 2029 al 2035), corresponde a la consolidación de la Inteligencia Artificial General (AGI). Una arquitectura tecnológica capaz de absorber cualquier conocimiento humano e incrustar creatividad cognitiva, autonomía y lógica en paralelo. Una computadora AGI podría ser comisionada simultáneamente a curar un cáncer subyacente y programar un sistema operativo radicalmente nuevo.

Tras cruzar la AGI, el evento culmen físico-tecnológico es el arribo de la Superinteligencia Artificial (ASI). Aquel límite, descrito académicamente como la Singularidad Tecnológica, presenta una amalgama algorítmica cuya destreza y cognición sobrepasa la suma integral de toda la población biológica de la Tierra en todas las materias simultáneamente. Llegado este horizonte teórico, la humanidad se acatará a una de dos resoluciones: Una subordinación estructural pasiva (entregando las llaves del timón biológico e institucional al silicio), o bien forjando una profunda hibridación neuro-tecnológica vía interfaces corporales (Brain-Computer Interfaces) liderando el salto evolutivo más dramático desde el Homo Sapiens.